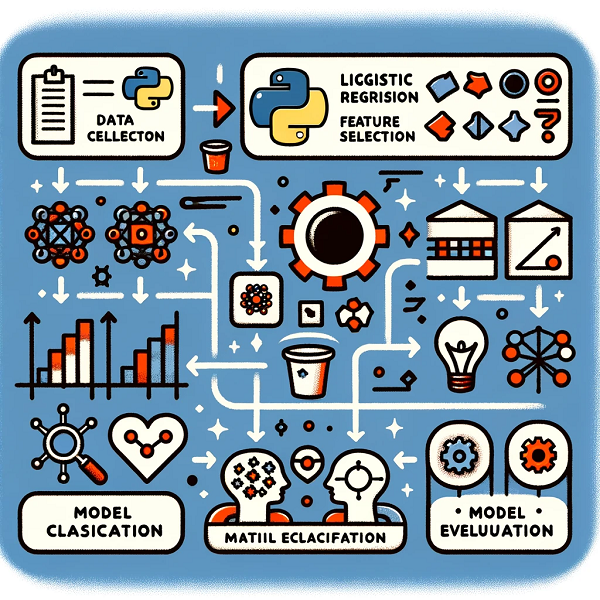

Scikit-learnのロジスティック回帰について詳細に説明します。

ロジスティック回帰は、統計学および機械学習で広く使用される分類手法の一つです。

この手法は、特に二値分類問題(例えば、メールがスパムかどうか、患者が特定の病気を持っているかどうかなど)において効果的です。

Scikit-learnは、Pythonの主要な機械学習ライブラリの一つであり、ロジスティック回帰を含む多くの機械学習アルゴリズムを提供しています。

ロジスティック回帰の基本

ロジスティック回帰は、与えられた入力特徴に基づいて、出力が特定のクラスに属する確率をモデル化する回帰分析の一種です。

この手法は、以下のような特徴を持っています。

- 確率的アプローチ: 出力は0から1の間の確率で表され、特定の閾値(一般的には0.5)を超える場合、サンプルは「1」のクラスに分類されます。

- シグモイド関数: 出力はシグモイド(またはロジスティック)関数を使用して0と1の間に制限されます。

- バイナリ分類: 主に二値分類問題に使用されますが、多クラス分類にも拡張可能です。

Scikit-learnにおけるロジスティック回帰

Scikit-learnでは、LogisticRegression クラスを使用してロジスティック回帰モデルを実装します。

このクラスは非常に柔軟で、多くのパラメータを調整することができます。

主要なパラメータ

solver: 最適化のためのアルゴリズムを指定します(例:'liblinear','sag','saga')。penalty: 正則化の種類を指定します(例:l1,l2)。正則化は過学習を防ぐために使用されます。C: 正則化の強度を制御します。値が小さいほど、正則化が強くなります。

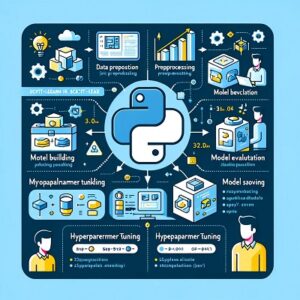

モデルのトレーニング

モデルのトレーニングは非常に簡単です。

まず、データを準備し、次にモデルをインスタンス化し、fit メソッドを使用してトレーニングデータに適合させます。

from sklearn.linear_model import LogisticRegression

from sklearn.model_selection import train_test_split

from sklearn.datasets import load_iris

# データの読み込み

X, y = load_iris(return_X_y=True)

# データの分割

X_train, X_test, y_train, y_test = train_test_split(X, y, test_size=0.2)

# モデルのインスタンス化とトレーニング

model = LogisticRegression()

model.fit(X_train, y_train)モデルの評価

モデルのパフォーマンスを評価するために、score メソッドを使用してテストデータの正確性を計算することができます。

accuracy = model.score(X_test, y_test)

print(f"Accuracy: {accuracy}")使用上の注意

ロジスティック回帰を使用する際には、以下の点に注意する必要があります。

- データの前処理: ロジスティック回帰は、特徴のスケールに敏感です。したがって、データを標準化するか正規化することが重要です。

- 特徴選択: 重要でない特徴はモデルのパフォーマンスに悪影響を及ぼす可能性があるため、適切な特徴選択が重要です。

- クラスの不均衡: データセットにクラスの不均衡がある場合、パフォーマンスが低下する可能性があります。これを対処するためには、適切なサンプリング手法や重み付けを考慮する必要があります。

まとめ

Scikit-learnのロジスティック回帰は、バイナリ分類問題に対する強力で柔軟なツールです。

モデルの訓練と評価は簡単で、多くのパラメータを調整して、特定のデータセットや問題に適したモデルを作成することができます。

ただし、データの前処理、特徴選択、クラスの不均衡といった要因にも注意を払う必要があります。

以上、Scikit-learnのロジスティック回帰についてでした。

最後までお読みいただき、ありがとうございました。