CNN(Convolutional Neural Network:畳み込みニューラルネットワーク)は、画像や映像のように空間構造を持つデータを扱うために設計された深層学習モデルです。

画像認識、画像分類、物体検出、セグメンテーションなどの分野において、長年にわたり中核技術として利用されています。

CNNの大きな特徴は、画像を単なる数値の集合として処理するのではなく、「近くにある画素同士は意味的に関連している」という前提を、モデル構造そのものに組み込んでいる点にあります。

なぜCNNは画像認識に適しているのか

全結合型ニューラルネットワークで画像を処理しようとすると、次のような課題が生じます。

- 入力次元が非常に大きくなり、パラメータ数が膨大になります

- 画素の位置関係が失われやすくなります

- 過学習しやすく、計算コストも高くなります

CNNでは、「局所受容野」と「重み共有」という2つの考え方を採用することで、これらの問題を解決しています。

その結果、画像の局所的な特徴を効率よく学習し、それを画像全体へ一般化することが可能になります。

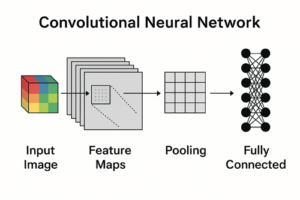

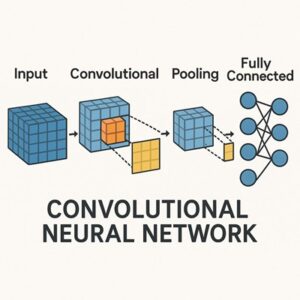

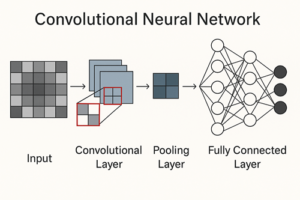

畳み込み処理の役割

畳み込み層では、小さなフィルタを画像全体に適用し、特徴マップを生成します。

このフィルタは学習によって最適化され、画像中の特定のパターンに強く反応するようになります。

例えば、次のような特徴が学習されます。

- 明暗の変化や境界

- 特定方向の線

- 模様やテクスチャ

- 色の変化パターン

同じフィルタが画像のどの位置でも使われるため、特徴の位置が変わっても検出できるという性質が得られます。

また、パラメータ数を大幅に削減できる点も重要な利点です。

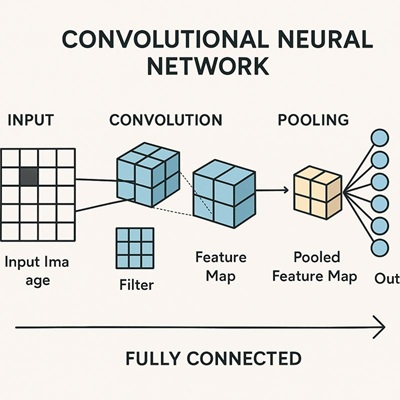

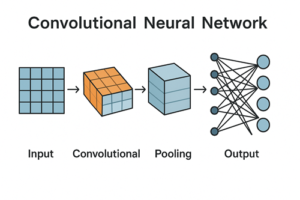

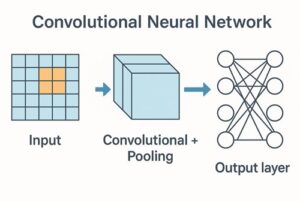

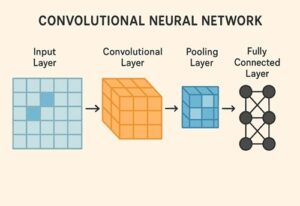

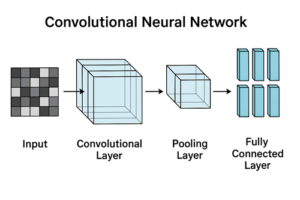

CNNを構成する主な層

CNNは、いくつかの種類の層を組み合わせて構成されます。

畳み込み層

画像から特徴を抽出する中心的な層です。

複数のフィルタを用いることで、多様な特徴マップを生成します。

活性化関数

非線形性を導入するために用いられます。

現在はReLUが標準的に使用されており、学習を安定させる効果があります。

プーリング層

特徴マップを空間的に圧縮し、計算量の削減やノイズへの耐性向上に寄与します。

ただし近年では、必須の構成要素ではなく、ストライド付き畳み込みやGlobal Average Poolingで代替される場合もあります。

出力層

抽出された特徴を統合し、最終的な予測を行います。

全結合層を用いる場合もあれば、Global Average Poolingの後に線形層のみを配置する設計も一般的です。

特徴表現の階層性

CNNでは、層を重ねることで特徴が段階的に抽象化されていきます。

- 浅い層では、色やエッジなどの低レベルな特徴が学習されます

- 中間層では、模様や局所的な構造が捉えられます

- 深い層では、より意味的で抽象的な特徴が表現されます

ただし、この階層構造はあくまで一般的な傾向であり、実際に学習される特徴は、タスクやデータセット、モデル設計によって異なります。

学習の仕組み

CNNの学習は、以下の流れで行われます。

- 入力画像から予測結果を出力します

- 正解ラベルとの差を損失関数によって数値化します

- 誤差逆伝播により、各パラメータの勾配を計算します

- 最適化手法(SGDやAdamなど)を用いて重みを更新します

分類問題では、Softmaxとクロスエントロピー損失の組み合わせが一般的に使用されます。

代表的なCNNモデル

CNNは長年にわたって改良が重ねられ、多くの代表的なモデルが提案されてきました。

- LeNet:CNNの原型となったモデルです

- AlexNet:大規模画像認識においてCNNの有効性を示しました

- VGG:単純な構造を深く積み重ねた設計です

- ResNet:残差接続により、非常に深いネットワークを実現しました

- MobileNet:計算量を抑えた軽量モデルです

- EfficientNet:精度と計算効率のバランスを重視しています

近年では、CNNの設計を見直し、より高性能を目指したアーキテクチャも登場しています。

実務での利用と転移学習

実務においては、CNNを一から学習させるケースは多くありません。

一般的には、事前学習済みモデルを用いた転移学習が採用されます。

転移学習を用いることで、

- 少ない学習データでも高い精度が得られます

- 学習時間や計算コストを抑えられます

- 安定した性能を実現しやすくなります

といった利点があります。

CNNの課題と対策

主な課題

- データが少ない場合に過学習しやすい点

- モデルの内部構造が理解しにくい点

- 計算資源を必要とする点

主な対策

- 転移学習の活用

- データ拡張による学習データの増強

- DropoutやBatch Normalizationなどの正則化手法の導入

まとめ

CNNは、画像データの空間構造を活かしながら、特徴を階層的に学習するための深層学習モデルです。

畳み込みと重み共有という仕組みにより、高次元な画像データを効率よく扱うことができます。

現在では、転移学習を前提とした実務利用が一般的となっており、画像認識技術の基盤として、今なお重要な役割を果たしています。

以上、CNNによる画像認識についてでした。

最後までお読みいただき、ありがとうございました。