畳み込みニューラルネットワーク(CNN)は、画像認識を中心に、現在の深層学習分野を支えている最重要モデルのひとつです。

一見すると難解に見えますが、実装の考え方は「どのようにデータを流し、どこで情報を要約していくか」を理解すれば、決して複雑ではありません。

ここでは、CNNを実装するうえで本当に必要な知識だけに絞り、仕組み・設計・注意点を順序立てて解説します。

CNN実装で最初に理解すべき「データの形」

CNNの実装で最も多い失敗は、モデルそのものではなく「入力データの形」を正しく理解していないことから起こります。

画像データは、単なるピクセルの集まりではなく、「高さ」「幅」「色チャンネル」という構造を持っています。

さらに、実際の学習では複数枚の画像をまとめて処理するため、「バッチ」という概念も加わります。

重要なのは、使用するフレームワークによって、データの並び順が異なるという点です。

- PyTorchでは、色チャンネルが先に来る並び方が基本

- TensorFlowやKerasでは、色チャンネルが最後に来る並び方が基本

この違いを意識せずに実装を進めると、エラーが出たり、学習がうまく進まなかったりします。

CNNの実装は、まず「今、自分はどの並び順を使っているのか」を把握することから始まります。

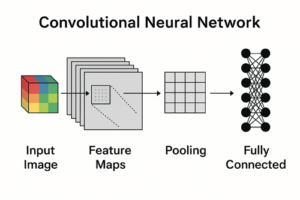

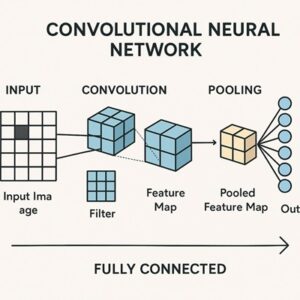

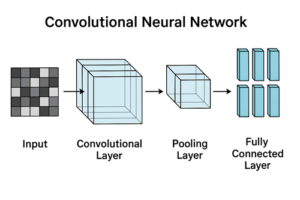

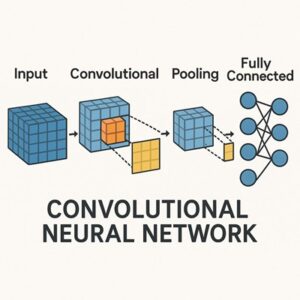

畳み込み層がやっていることを正しく理解する

畳み込み層は、画像の中を小さな窓でスキャンしながら、特徴を抽出していく仕組みです。

このとき重要になるのが、次のような設計要素です。

- どれくらいの大きさの窓で見るのか

- 窓をどの程度の間隔で動かすのか

- 画像の端をどのように扱うのか

- 何種類の特徴を同時に学習するのか

これらの設定によって、出力される特徴マップの大きさや情報量が決まります。

実装時によく起こる問題として、「思っていたより特徴マップが小さくなってしまい、後段の処理とつながらない」というケースがあります。

これは畳み込みや縮小処理の影響を正確に把握できていないことが原因です。

CNNでは、空間サイズがどの段階でどれくらい縮小されていくのかを常に意識する必要があります。

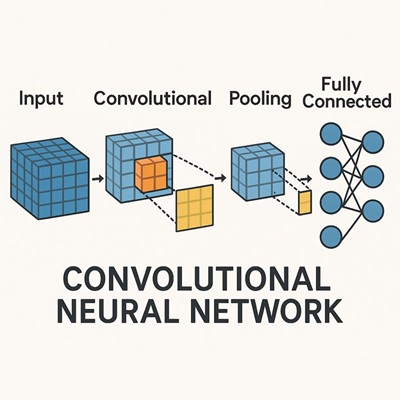

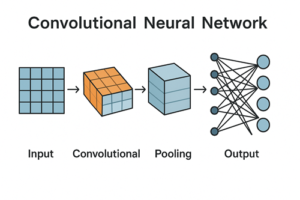

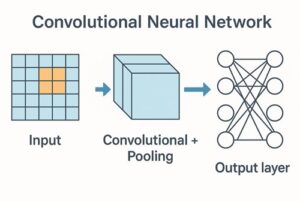

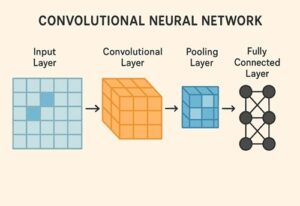

CNNの基本構造は意外とシンプル

多くのCNNは、次のような流れを繰り返すことで構成されています。

- 画像から局所的な特徴を取り出す

- 特徴のばらつきを整える

- 非線形変換で表現力を高める

- 必要に応じて解像度を下げる

この一連の流れを何度も重ねることで、「エッジ → 模様 → 部品 → 全体像」といった具合に、より抽象的な特徴を学習できるようになります。

近年では、特徴の正規化処理を組み込んだ構成がほぼ標準になっており、単に畳み込みと活性化関数を並べるだけよりも、安定して学習が進むようになっています。

最小構成のCNNが持つ意味

CNNを理解するうえで重要なのは、いきなり高性能なモデルを使うことではありません。

まずは「小さく、単純な構造」を自分で組み立ててみることが理解への近道です。

最小構成のCNNでは、

- 入力画像を段階的に圧縮しながら特徴を集約し

- 最後に分類用の判断を行う

という一連の流れを、はっきりと追うことができます。

この段階で、「なぜここでサイズが半分になるのか」「なぜここで情報が集約されるのか」を説明できるようになると、CNNの本質が見えてきます。

学習時に最も重要な「出力と損失関数の関係」

CNNの実装で特に注意が必要なのが、モデルの出力と損失関数の組み合わせです。

多クラス分類の場合、モデルは「各クラスらしさ」を数値として出力します。

この数値は、そのまま確率として解釈されるわけではなく、「確率に変換される前の情報」であることが一般的です。

そのため、損失関数側が「確率に変換する処理まで含めて面倒を見る」設計になっているケースが多く、モデル側で余計な処理をしてしまうと、学習がうまく進まなくなります。

この部分は、フレームワークごとに流儀が決まっているため、「どこで確率化が行われるのか」を必ず意識する必要があります。

実装がうまくいかない原因の大半はここにある

CNNの実装で詰まりやすいポイントは、驚くほど共通しています。

- データの並び順を勘違いしている

- 出力の形式と損失関数が合っていない

- 学習用と評価用の設定を切り替えていない

- 入力サイズを固定前提で設計してしまっている

特に初心者のうちは、「モデルは正しそうなのに精度が出ない」という状況に陥りがちです。

その多くは、モデル構造そのものではなく、周辺設定の不一致が原因です。

過学習とどう向き合うか

CNNは表現力が高いため、データ量が少ないと簡単に過学習します。

これを防ぐためには、次のような考え方が重要になります。

- 入力データそのものを増やす工夫をする

- モデルに余計な自由度を与えすぎない

- 学習の進み具合を監視し、早めに止める

- すでに学習済みのモデルを活用する

特に現実のタスクでは、ゼロからCNNを学習するよりも、事前学習済みモデルを微調整する方が圧倒的に効率的なケースがほとんどです。

実務レベルのCNN設計に近づくために

実装に慣れてきたら、次のような方向に設計を進化させると、より実務に近づきます。

- 固定サイズに依存しない構造にする

- 学習を安定させる最適化手法を使う

- 学習率を段階的に調整する

- 目的に合った評価指標を選ぶ

これらは一見細かい調整に見えますが、モデルの再現性や保守性に大きく影響します。

まとめ

CNNの実装は、「複雑な数式を理解すること」よりも、

- データがどのように流れていくのか

- 各層がどんな役割を持っているのか

- 出力と学習方法が正しく対応しているか

この3点を正確に把握することが何より重要です。

コードを書き始める前に、この流れを言葉で説明できるようになると、CNNの実装は一気に「理解できるもの」へ変わります。

以上、CNNの実装方法についてでした。

最後までお読みいただき、ありがとうございました。