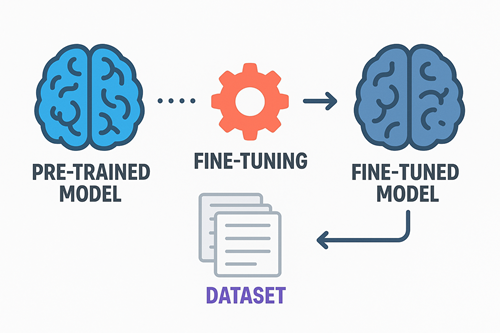

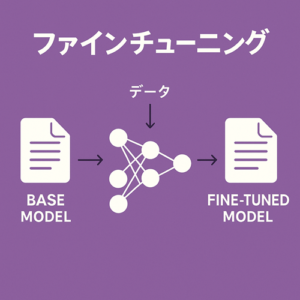

ファインチューニング(Fine-Tuning)とは、あらかじめ大量のデータで学習された大規模言語モデル(LLM)に対し、追加データを用いて“目的に合わせた再学習”を行う技術です。

これにより、モデルは特定領域・特定スタイル・特定タスクに最適化され、汎用モデルでは再現しきれない高度な一貫性や精度を実現します。

ファインチューニングとは何か?

すでに学習済みのAIに「追加の学習例」を与えることで、次のような能力向上が期待できます。

- 書き方・文体・スタイルの統一

- 特定分野の知識強化

- 望ましいフォーマットで安定した出力

- 特定タスクへの高い再現性

汎用AIをそのまま使うのではなく、目的に最適化された専用モデルに育てる工程とイメージするとわかりやすいでしょう。

ファインチューニングで得られる主な効果

文体やルールを正確に再現できる

書籍、マニュアル、技術文章など、スタイルが明確なデータを学習させると、その特徴を正確に再現できるようになります。

専門領域の回答精度が高まる

法律・技術文書・学術領域など、一般モデルでは精度にばらつきが出やすい分野でも、学習データを与えることで安定性が向上します。

指定フォーマットでの出力が安定

レポート、解説書、Q&Aなど、一定の構成やスタイルを要求するタスクに向いています。

作業の再現性が高まる

毎回手動で指示を調整しなくても、モデルが“求められている答えの型”を理解した状態で動作します。

ファインチューニングの種類(実務での整理)

学術的な分類とは別に、目的ベースで整理すると次のようになります。

文体・表現チューニング

文章の特徴、説明のテンポ、語彙選択など“スタイル”を覚えさせる。

フォーマット再現チューニング

特定の文章構造・出力形式・手順書などの“型”を再現させる。

領域特化チューニング

特定の知識領域に強いモデルを作る。

※いずれも“公式分類”ではなく、現場で扱いやすい概念整理です。

ファインチューニングの手順

ここでは一般的なプラットフォーム(例:OpenAI)を想定した標準的な流れを説明します。

STEP 1:学習データの準備

データの品質が結果を大きく左右します。

良いデータの条件は次の通りです。

- 情報が正確である

- 文体・トーン・形式が一貫している

- 目的に合致した内容だけで構成されている

- 不要な情報(誤り・別の文体・例外的表現など)が含まれていない

模範的な出力のみを集めることが最重要です。

STEP 2:データをフォーマット化する

ファインチューニングでは多くの場合、「Input/Output」形式のデータを使用します。

例

Input

「次の内容を基に要約を作成してください:●●」

Output

(理想的な形式で書かれた要約)

こうしたペアを多数作成し、JSONL形式に整形します。

STEP 3:学習(Fine-Tuningジョブ)を実行

- モデルを選ぶ

- データをアップロード

- 学習ジョブを開始

これだけで数分〜数十分後には“独自のチューニング済みモデル”が生成されます。

STEP 4:評価とブラッシュアップ

出来上がったモデルを次の観点で検証します。

- 一般モデルとの比較

- 出力の再現性

- 文体・知識・回答形式の統一性

- 必要な修正を踏まえた再学習

評価→修正→再学習というサイクルを回すほど完成度は高まります。

ファインチューニングの注意点

ここを理解していないと、結果が大きく劣化する可能性があります。

データ質の低下=モデル品質の低下

誤情報、文体ぶれ、曖昧なルールなどが混ざると、その癖をそのまま学習してしまいます。

→ データは“最良の例だけ”を厳選すること。

過度な学習は柔軟性を損なう

いわゆる「過学習(オーバーフィッティング)」が起こると、汎用的なタスクへの対応力が低下します。

対策

- データ量を必要以上に増やしすぎない

- 明確な目的に絞る

- 指示テキスト(システムプロンプト)との併用で柔軟性を確保

著作権・個人情報の取り扱い

- 他者の文章を無断学習させるのはNG

- 個人名・メール・住所などは除去

- 自社または権利が明確なデータのみ使用する

1モデル=1目的で設計する

複数のタスクを一つのモデルに混ぜると、挙動が不安定になります。

例

- 要約モデル

- 解説モデル

- Q&Aモデル

と分ける方が高精度になります。

データ量の考え方

- 文体・形式の学習:少量(50〜200件)でも効果が出る

- 専門知識の強化:数百〜数千件が必要になる場合もある

データ量よりもデータの品質の方が優先度が高い点は変わりません。

プロンプト最適化との違い

| 項目 | プロンプト最適化 | ファインチューニング |

|---|---|---|

| 方法 | 指示文で出力を調整 | モデルそのものを学習 |

| コスト | 低い | 学習コストが必要 |

| 柔軟性 | 高い | 目的に特化するぶん汎用性が下がることも |

| 再現性 | 指示次第で変わる | 一貫性が高く安定 |

大量の作業や、一定形式の出力が求められる場面ではファインチューニングが優位です。

まとめ

ファインチューニングは、汎用AIを“目的特化型の専用モデル”へと進化させる強力な方法です。

- データ品質が最重要

- 目的はひとつに絞る

- 過学習に注意

- 権利と情報管理は厳重に

- 出力の安定性向上に大きく貢献

適切に行えば、一般モデルでは達成できない精度と安定性を実現できます。

最後までお読みいただき、ありがとうございました。