目次

用語の基本的な意味

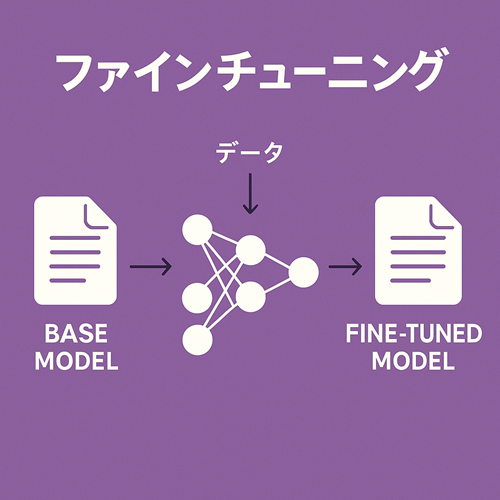

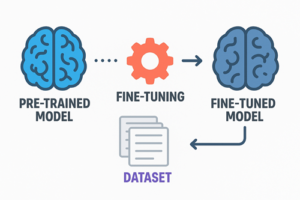

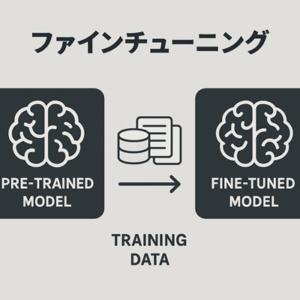

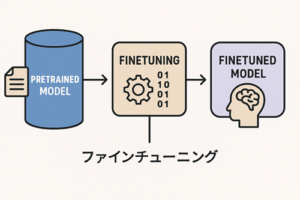

ファインチューニング(fine-tuning)とは、すでに事前学習されたモデルに対して、特定の目的やデータに合わせて追加学習を行う手法を指す。

ベースとなるモデルは大規模データで事前学習されており、そのパラメータを一部更新することで、用途に応じた出力が得られるように調整する。

この方法は、フルスクラッチ(モデルを最初からすべて学習する方法)に比べて、計算コストやデータ量を抑えつつ特定タスクへの適応を実現できる。

日本語として使われる代表的な訳語

ファインチューニングに対応する日本語表現には次がある。

微調整

- モデルのパラメータを細かく調整するというニュアンスを含む。

- 技術文書においても一般的に使われる。

追加学習

- 既存モデルに対して「学習を追加する」プロセス全般を指す。

- 文脈によってはファインチューニングの一形式として用いられる。

調整 / チューニング

- より抽象的な表現であり、具体的な手法を限定しない。

類似概念との区別

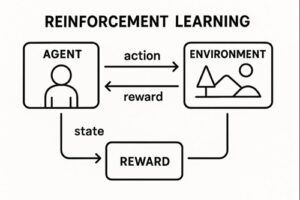

転移学習(Transfer Learning)

転移学習は、あるタスクで学習した知識を別のタスクに応用する枠組みであり、ファインチューニングはその代表的な手法のひとつとして位置づけられる。

プロンプトエンジニアリング

- モデルのパラメータは更新せず、入力(プロンプト)を工夫して出力を制御する手法。

- モデル内部を変更するファインチューニングとはアプローチが異なる。

RAG(Retrieval-Augmented Generation)

- 日本語では「検索拡張生成」と呼ばれる。

- モデル本体を学習し直すのではなく、外部情報を検索して参照させる構造をとる。

- モデルそのものの重みを更新するファインチューニングとは異なる手法である。

用例

技術文書での例

- 事前学習済みモデルを特定データセットでファインチューニングした。

- 手元のデータを用いてモデルのパラメータを微調整した。

- タスク適応のために追加のエポックを用いて追加学習を行った。

実装・研究での説明例

- モデルの下位層を凍結し、上位層のみをファインチューニングする設定を採用した。

- 特定タスクに合わせて一部のパラメータを更新することで性能を改善した。

まとめ

- ファインチューニングは「事前学習済みモデルへの追加学習による調整」を指す技術用語である。

- 日本語では主に

「ファインチューニング」「微調整」「追加学習」

といった表現が用いられる。 - 類似する概念とは、

パラメータを更新するか/入力の工夫で制御するか/外部情報を参照するか

などの観点で区別できる。

以上、ファインチューニングは日本語でなんというのかについてでした。

最後までお読みいただき、ありがとうございました。